在人工智能领域,我们已经习惯了“日新月异”,但 Meta 刚刚甩出的这张“王炸”——SAM 3 & SAM 3D,依然让整个科技圈感到震撼。

如果说初代 SAM(Segment Anything Model)解决了“这是什么”的问题,SAM 2 搞定了“它去哪了(视频追踪)”的问题,那么刚刚发布的 SAM 3D 则回答了一个更终极的问题:“它长什么样(空间结构)”。

今天,我们就来扒一扒这个让 2D 照片“站起来”的黑科技到底有多离谱,以及它对我们未来的创作意味着什么。

第一部分:SAM 3D —— 让照片拥有“空间感

我们以前常说“二向箔打击”,把三维世界压成二维图片。而 SAM 3D 做的事情恰恰相反,它是在进行“升维”。

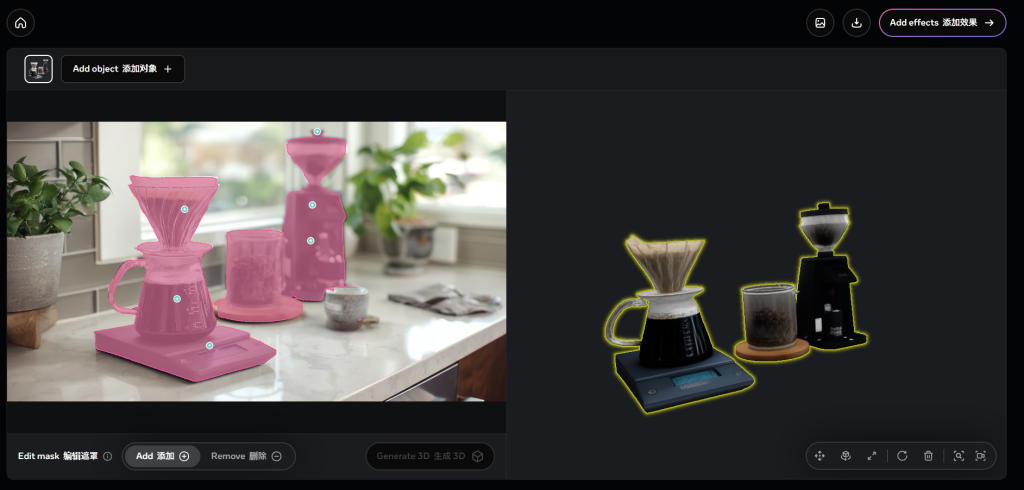

1. 核心能力:单图即 3D 在过去,想要得到一个 3D 模型,你需要昂贵的 3D 扫描仪,或者用手机围着物体拍几十张照片做摄影测量。但 SAM 3D 的核心突破在于:它只需要一张单眼照片(Single Image)。

- 脑补看不见的背面: AI 不再只是识别像素,它学会了“想象”。当你给它一张椅子的正面照,它能基于庞大的训练数据,预测出椅子的背面和侧面结构。

- 点云与网格的瞬间生成: 输入一张 JPG,输出一个 OBJ 或 GLB 文件。这对于游戏开发和 VR 内容创作者来说,简直是生产力的核爆。

2. 两大杀手锏模式

- SAM 3D Objects(万物皆可 3D): 针对鞋子、玩具、家具等刚性物体。它不仅能重建形状,还能较好地还原表面的纹理和光泽。

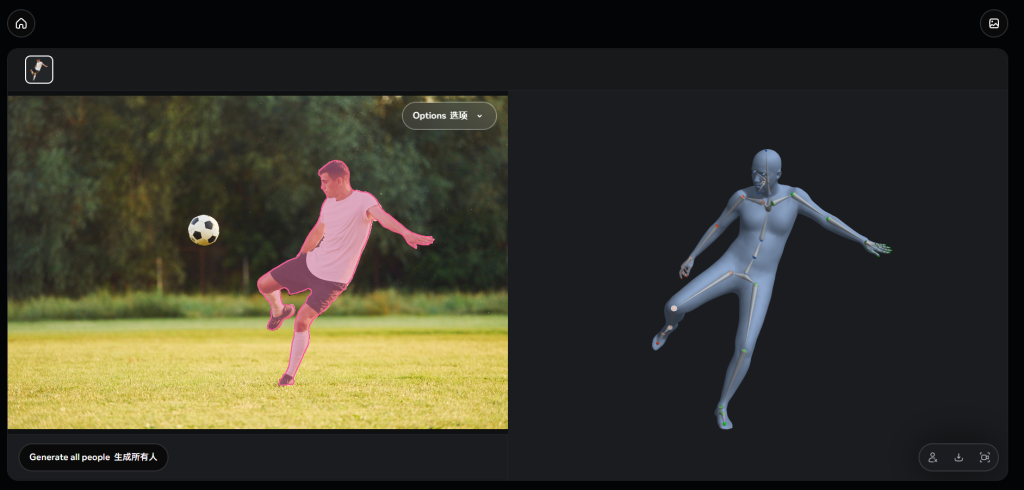

- SAM 3D Body(人体专项重建): 这是一个专门针对人类的精细化模型。它能从一张照片中精准还原人体的姿态、体型甚至衣物褶皱,直接用于虚拟试衣或数字人生成。

第二部分:SAM 3 —— 视频处理的“全能王

虽然大家的目光都被 3D 吸引,但同步发布的 SAM 3 同样不容小觑,它是 SAM 系列的正统续作,主攻视频分割与理解。

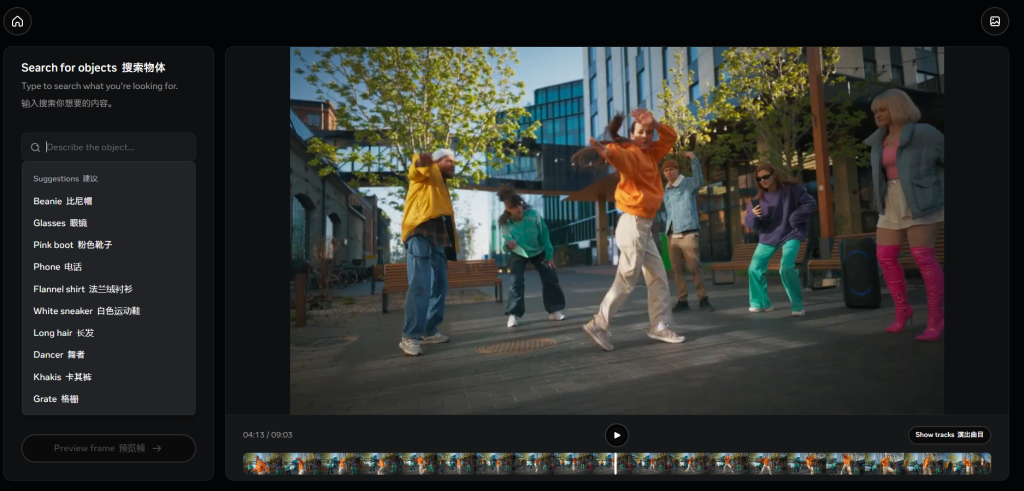

- 极智追踪: 相比 SAM 2,SAM 3 在处理遮挡、快速移动和物体变形时的稳定性有了质的飞跃。即便视频里的人转了个身,或者被树挡住了几秒,SAM 3 依然能死死“咬住”目标。

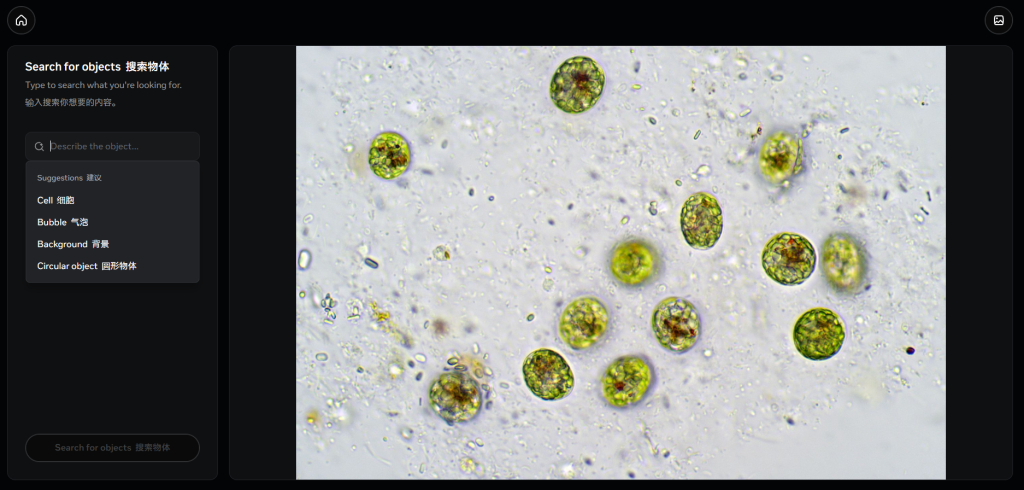

- 多模态交互: 你不仅可以用鼠标点击视频里的物体,还可以直接告诉它:“追踪那个穿红衣服正在跑步的人”。SAM 3 能听懂自然语言指令,实现了 NLP 与视觉的完美融合。

第三部分:技术原理浅析(给极客读者)

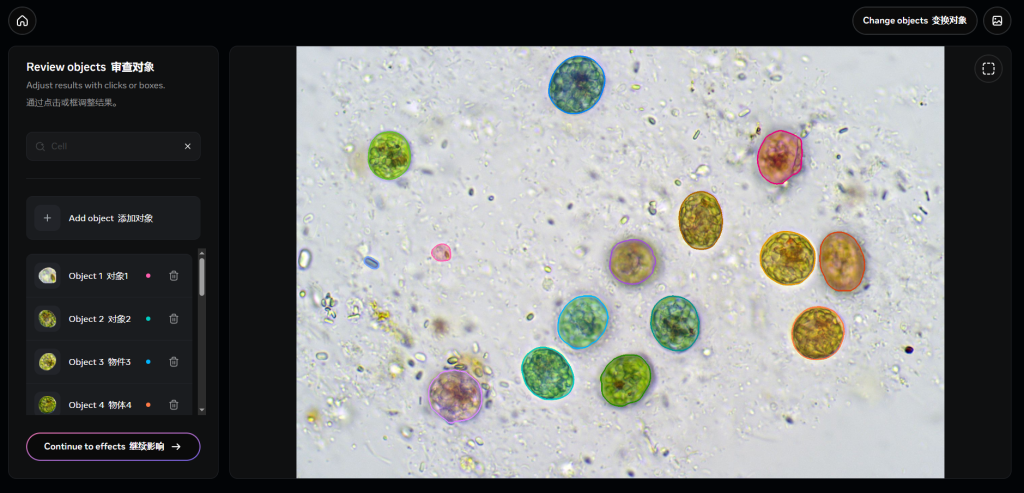

Meta 此次的技术突破,核心在于将 2D 分割掩码(Mask) 与 3D 几何先验 进行了深度结合。

- 稀疏视角重建: SAM 3D 利用了类似 Gaussian Splatting(高斯泼溅)或改进的 NeRF(神经辐射场)技术思想,从极少的信息中推断体积。

- 语义驱动的几何补全: AI 不是在瞎猜背面,而是理解了“这是一辆车”,所以它知道车有四个轮子,以此来约束 3D 生成的形状,防止生成“克苏鲁”式的怪异模型

第四部分:这东西能用来干嘛?

这项技术的应用前景,远比我们想象的广阔:

- 电商革命: 淘宝/亚马逊卖家不再需要花钱做 3D 建模。拍一张商品图,直接生成 3D 展示,用户可以在手机上 360 度看鞋子细节。

- 独立游戏开发: 独立开发者以前最头疼的是美术资产。现在,你在路边拍个消防栓、拍个垃圾桶,瞬间就能变成游戏里的 3D 资产(Asset)。

- XR 与元宇宙: Apple Vision Pro 等设备急需大量的 3D 内容。SAM 3D 极大降低了 3D 内容的生产门槛,让“把现实世界数字化”变得触手可及。

- 影视特效: 视频抠像和后期合成将变得前所未有的简单和自动化。

Meta 最令人敬佩的一点在于坚持开源。这意味着,SAM 3 和 SAM 3D 的代码和模型权重将再次免费提供给全球开发者。

如果在 2023 年我们还在惊叹 ChatGPT 读懂了文字,那么 2026 年,SAM 3D 让我们看到了 AI 读懂物理世界的开端。

🔗 资源链接:

- Github 项目地址: [https://github.com/facebookresearch/sam-3d-objects]

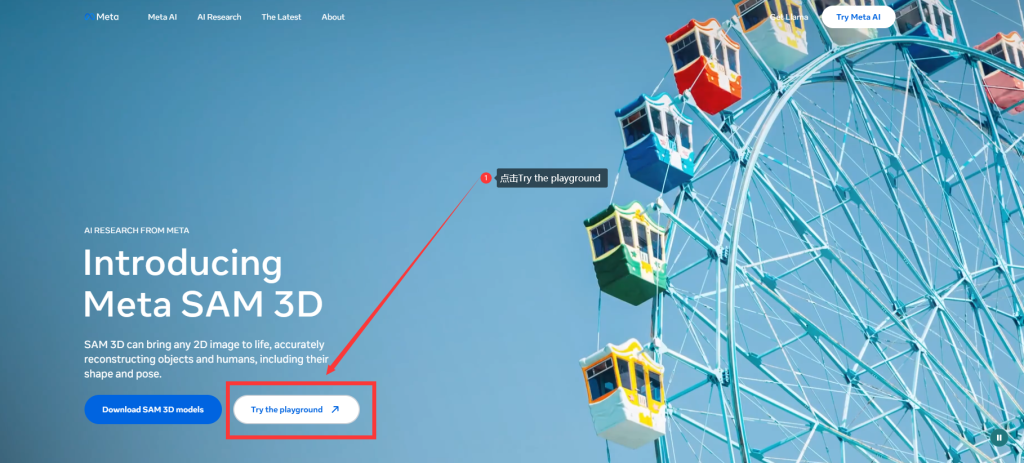

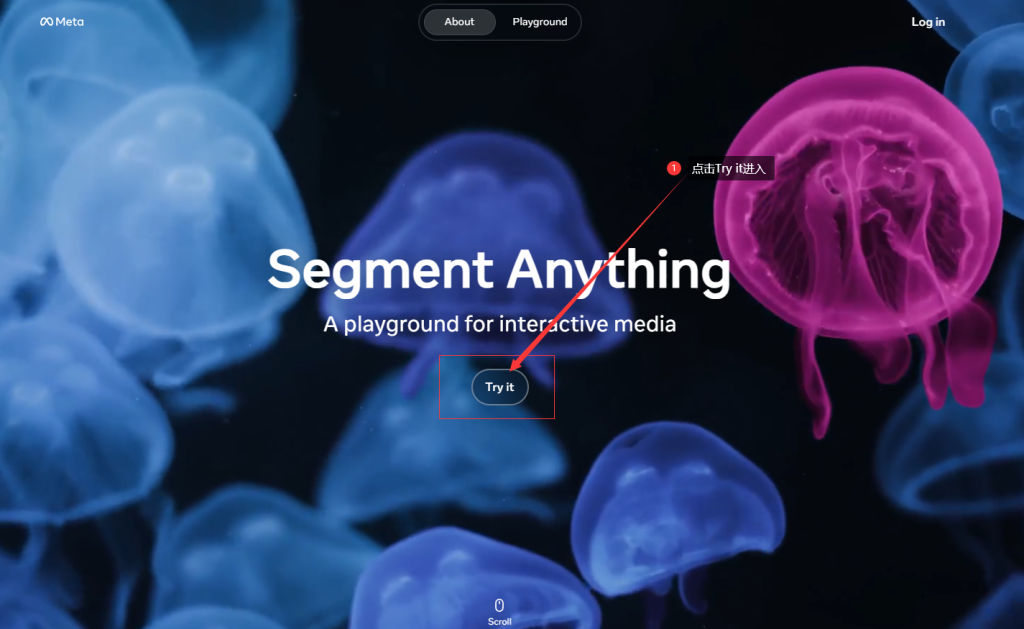

- 在线试玩 Demo: [在线试玩]

更多好玩的功能,还需要大家亲自去探索,它的2D转3D功能确实非常强大,只需要点击图片中的物体,AI就能自动识别出3D模型,速度非常快,对于3D建模的用户来说简直就是一把利剑。